0147 - Quando a inteligência artificial melhora com mais conversa e menos formalidade

agenteGPT – desde março de 2023 compartilhando ideias e experiência de usuário.

Existe uma crença quase intuitiva de que inteligência está associada à formalidade. Espera-se que sistemas sofisticados sejam educados, pacientes e perfeitamente organizados em suas respostas. No entanto, pesquisas recentes em inteligência artificial estão começando a mostrar algo curioso: quando retiramos parte dessa camada de formalidade social, os sistemas podem raciocinar melhor. Um estudo conduzido por pesquisadores da Carnegie Mellon University, nos Estados Unidos, e da Mohamed bin Zayed University of Artificial Intelligence, em Abu Dhabi, investigou exatamente isso.

A equipe testou o que chamaram de Rude-Assistant Alignment, uma abordagem que, em vez de incentivar respostas excessivamente cordiais, estimula a IA a responder de maneira mais direta, até mesmo um pouco...rude.

A mudança parece pequena, mas os resultados chamaram atenção. Quando a IA foi orientada a ser mais objetiva e menos “boazinha”, seu desempenho em tarefas complexas de raciocínio aumentou significativamente. Houve ganho de cerca de 50% na precisão, por exemplo.

O motivo é relativamente simples na avaliação dos pesquisadores: quando o modelo deixa de investir energia tentando parecer simpático, ele concentra mais processamento na lógica do problema. Em vez de envolver a resposta em camadas de cordialidade, como “claro, posso ajudar” ou “vamos analisar juntos”, o ChatGPT, o Gemini e outras ferramentas vão direto ao ponto e priorizam a dedução de conclusões, a estrutura da tarefa e a sequência lógica necessária para resolvê-la.

Essa descoberta, por si só, já é interessante. Mas também aponta para algo maior.

O que os pesquisadores descobriram na engenharia dos modelos confirma algo que muitos usuários já percebem na prática: a inteligência da IA melhora quando a interação deixa de ser mecânica e passa a se parecer com uma conversa real.

Mas, observado com atenção, revela algo mais profundo sobre a natureza da interação com inteligência artificial e aponta para uma conclusão consistente: quanto mais a interação se aproxima de uma conversa real, melhores tendem a ser os resultados.

Durante muito tempo, popularizou-se a ideia de que usar bem a IA dependia principalmente de escrever um prompt perfeito cuidadosamente formulado que levaria o sistema a produzir exatamente o resultado desejado. Essa visão simplifica [e até robotiza] demais o processo.

Na prática, a inteligência artificial generativa funciona melhor quando a tarefa não é tratada como um comando isolado, mas como um processo contínuo de construção de contexto.

Não desista da conversa

Se esse é o caso, então usar bem a IA exige uma mudança de comportamento por parte do usuário. Em vez de tratar a interação como um pedido pontual seguido de uma resposta final, é preciso encarar o processo como uma conversa que pode - e muitas vezes deve - continuar.

Interaja. Questione. Reclame. Cobre.

Se a resposta não é o que você espera, pergunte: tem certeza?

Se o ChatGPT se afastou da instrução original, diga claramente:

você não está seguindo o que foi pedido.Se abandonou um padrão que estava funcionando bem, também é válido provocar:

você esqueceu o modelo que usou na interação anterior para a mesma tarefa?

Essas intervenções não atrapalham o processo. Ao contrário, alimentam o sistema com mais contexto, permitindo que a resposta seguinte seja melhor que a anterior. Isso significa que cada pergunta, cada correção e cada refinamento ajudam a aproximar o resultado do que realmente se espera.

Da lógica do comando para a lógica da colaboração

Quando o usuário passa a interagir dessa maneira, a natureza da relação com a tecnologia muda.

Em vez de uma lógica de comando, em que alguém dá uma ordem e espera uma execução perfeita, surge uma lógica de colaboração. A inteligência artificial deixa de ser apenas uma ferramenta de geração automática de respostas e passa a atuar como um sistema que participa da construção do resultado, algo que tenho defendido aqui na newsletter e também no trabalho de consultoria.

Nesse ambiente, a IA dialoga, refina ideias, sugere caminhos alternativos e, muitas vezes, surpreende com possibilidades que não surgiriam em um processo engessado de execução de tarefas. O resultado final não nasce de um único comando bem escrito, mas do acúmulo de interações que constroem contexto e refinam a solução ao longo da conversa e da forma como essa conversa é travada, como mostrou o estudo destacado acima.

O valor da IA não está em obedecer bem a um prompt. Está em cocriar melhor. O segredo não está em um comando certeiro, mas em uma relação contínua construída ao longo da interação.

A regra de ouro que continua valendo

Nada disso significa, porém, que o resultado produzido pela IA deva ser aceito automaticamente. Mesmo quando a interação é rica e produtiva, existe uma regra fundamental que não pode ser ignorada: todo conteúdo gerado por inteligência artificial precisa passar por um refinamento final antes de ser publicado ou utilizado.

Considerar respostas da IA como material pronto para copiar e colar é um um erro que pode ter consequências reais. O uso responsável da inteligência artificial envolve sempre três etapas complementares: geração inicial de conteúdo, interação para ajuste e melhoria das respostas e, por fim, uma revisão humana criteriosa antes de qualquer divulgação ou aplicação prática.

Quando observamos as pesquisas recentes sob essa perspectiva, fica mais claro o que elas realmente revelam. A inteligência artificial generativa não é apenas uma tecnologia de produção automática de respostas. É, antes de tudo, uma tecnologia de comunicação.

Seu desempenho melhora quando a interação se torna mais rica, mais dinâmica e mais próxima das conversas humanas com perguntas, correções, discordâncias e refinamentos ao longo do caminho. Talvez por isso o maior erro [e uma das grandes dificuldades] no uso da IA generativa seja tratá-la como uma máquina de respostas imediatas.

No fim das contas, o segredo de usar bem essa tecnologia não está em descobrir o comando perfeito. Está em aprender a conversar com ela. E no fim, a IA não melhora com comandos mais perfeitos, mas com interações mais ricas.

Leia também na agenteGPT:

Engenharia de contexto e “não peça, interaja”: técnica e filosofia no uso da IA

Mantenha o hábito: nem toda atualização da IA generativa vira a rotina do avesso

Por que você ainda não usa IA na sua rotina?

Prioridades e expectativas: o que realmente regula o uso da IA

Como a qualidade da interação humana influencia o resultado da IA

Leia sobre o estudo no site Olhar Digital.

Dê seu apoio para mais conteúdo

Acesse e assine.

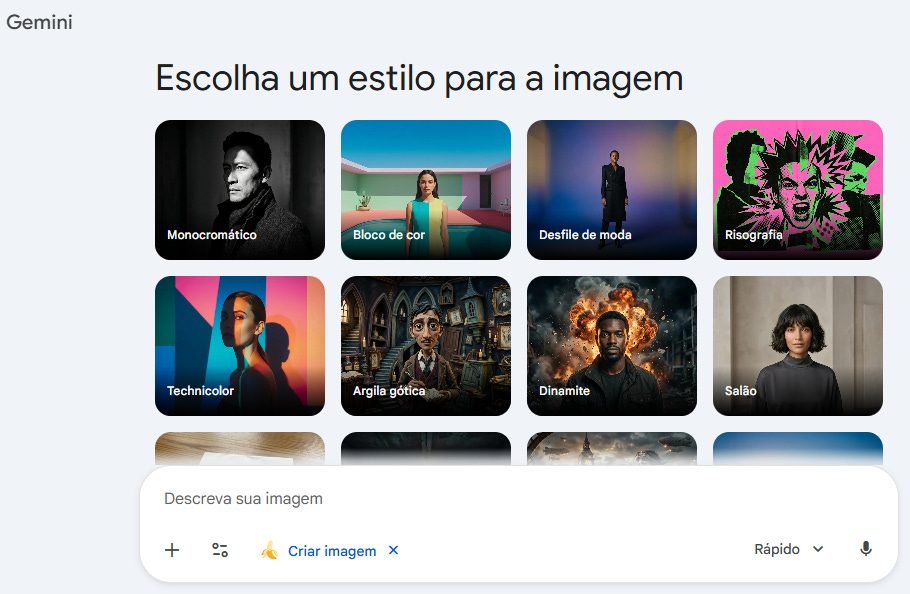

NOVIDADE NO GEMINI

Google atualiza geração de imagens

Além do criador de música, o Gemini anunciou também o Nano Banana 2, nova versão do modelo de geração de imagens integrado à IA generativa do Gemini. A atualização amplia os recursos da ferramenta e passa a oferecer maior velocidade na criação de imagens, além de melhorias na fidelidade visual e na interpretação de comandos de texto usados pelos usuários.

A estratégia da empresa é tornar a criação de imagens por inteligência artificial mais rápida e acessível, ampliando seu uso em áreas como marketing, produção de conteúdo e design digital. Entre as principais novidades está a combinação de recursos avançados antes restritos à versão profissional com a rapidez da linha Flash. Com isso, o Nano Banana 2 promete gerar imagens com mais precisão, melhor iluminação e maior nitidez, além de seguir instruções com mais fidelidade.

Na prática - Usei a ferramenta de imagem do Gemini nessa semana para uma tarefa que, antes dessa atualização, seria pura decepção: transformar um card de evento [com imagem e texto] do formato vertical para horizontal. Resultado excelente. Nenhuma perda, todos os elementos gráficos mantidos e textos todos corretos. Gostei - se mostrou útil.

Leia também na agenteGPT:

PARCERIA COM PENTÁGONO

Usuários do ChatGPT reagem e Claude cresce

A decisão da OpenAI de firmar uma parceria com o Departamento de Defesa dos Estados Unidos [Pentágono] desencadeou uma onda de críticas entre usuários e reacendeu o debate sobre o uso militar da inteligência artificial. Após o anúncio do acordo, o ChatGPT registrou um aumento de 295% nas desinstalações, segundo dados da plataforma de análise Sensor Tower. No mesmo período, o Claude. da Anthropic, ganhou usuários e chegou ao primeiro lugar no ranking da App Store americana, superando o principal concorrente.

Estopim

A polêmica ocorre em meio a um impasse entre as duas empresas sobre os limites do uso de IA por governos. Dias antes do anúncio da OpenAI, a Anthropic havia declarado que não permitiria que seus sistemas fossem utilizados pelo Departamento de Defesa para vigilância doméstica em massa ou para o desenvolvimento de armas autônomas capazes de agir sem intervenção humana. Pouco depois, a OpenAI seguiu caminho oposto e anunciou seu próprio acordo com o Pentágono.

O episódio desencadeou ainda uma disputa pública sobre ética e segurança no desenvolvimento de inteligência artificial. Enquanto o governo dos Estados Unidos chegou a classificar a Anthropic como um “risco à cadeia de suprimentos” e determinou a suspensão do uso de seus produtos em agências federais, a empresa registrou crescimento acelerado de usuários. E recentemente na Cúpula da IA na Índia, os CEOs das duas empresas, Sam Altman [OpenAI] e Dario Amodei [Anthopic] se recusaram a segurar as mãos na foto oficial do evento - um mico.

A Anthropic também aproveitou o momento para lançar recursos que facilitam a migração de usuários de outras plataformas, incluindo a possibilidade de importar históricos de conversas de ferramentas concorrentes.

Leia também na agenteGPT:

ELEIÇÕES 2026

TSE aprova regras para uso de IA e chatbots

O Tribunal Superior Eleitoral (TSE) aprovou um novo conjunto de resoluções que regulamenta o uso de inteligência artificial e ferramentas digitais durante as eleições gerais de outubro. As normas estabelecem limites para candidatos, partidos, plataformas digitais e aplicações de IA, com o objetivo de reduzir a desinformação e proteger a integridade do processo eleitoral.

As resoluções, aprovadas por unanimidade, fazem parte de um pacote mais amplo de regras que orientarão o pleito em que os eleitores escolherão presidente da República, governadores, senadores e deputados federais, estaduais e distritais.

Confira as principais medidas:

Conteúdos manipulados com imagem, voz ou vídeo de candidatos não poderão ser publicados ou compartilhados nas 72 horas antes da votação e nas 24 horas após o pleito.

Ferramentas de IA, como chatbots e assistentes digitais, estão proibidas de sugerir em quem o eleitor deve votar ou de favorecer determinados candidatos em respostas a usuários.

Sistemas de inteligência artificial não poderão priorizar informações sobre alguns candidatos em detrimento de outros, evitando desequilíbrios no acesso a informações políticas.

Materiais de propaganda que utilizarem inteligência artificial deverão informar claramente que o conteúdo foi produzido ou alterado por essa tecnologia.

Plataformas e aplicações de IA deverão retirar conteúdos ilícitos mesmo sem decisão judicial, informando ao usuário o motivo da remoção e garantindo direito de recurso.

Em situações em que seja difícil comprovar manipulação digital, o juiz eleitoral poderá exigir que o autor da publicação demonstre como a IA foi utilizada e comprove a veracidade do conteúdo.

NO RADAR

Apesar do receio

IA deve transformar 22% das ocupações até 2030 [Monitor Mercantil]

Estudo do Fórum Econômico Mundial aponta que automação e novas tecnologias podem eliminar 92 milhões de postos de trabalho, mas também criar cerca de 170 milhões de novas vagas até o fim da década.

Momento favorável

Veja 10 profissões que estão decolando com a inteligência artificial [ICL Notícias]

Empresas já oferecem salários até 47% maiores para atrair profissionais com habilidades em inteligência artificial, área que vive forte expansão no mercado de trabalho.

Leia também na agenteGPT:

Dominar o uso da IA já deveria fazer parte da descrição das vagas em comunicação?

ASPAS SOBRE IA E JORNALISMO

Carta aberta

“A Inteligência Artificial está remodelando fundamentalmente a forma como o conteúdo é criado, distribuído, descoberto e monetizado. Acreditamos que precisamos nos unir para proteger o jornalismo original e garantir a sustentabilidade a longo prazo do nosso setor. A IA traz oportunidades para as editoras e para o nosso público. As nossas organizações já estão na vanguarda da utilização da IA de forma responsável, em benefício do nosso público. Mas a IA também levanta questões urgentes sobre imparcialidade, consentimento, atribuição, transparência e confiança”.

Trecho da carta aberta assinada pelos executivos que comanda os principais veículos do Reino Unido [BBC, Financial Times, The Guardian, Sky News e Telegraph] em que convidam outros líderes globais dos setores editorial, de radiodifusão, mídia e notícias para juntarem a coalizão SPUR [sigla para The Standards for Publisher Usage Rights, em português “Padrões para Direitos de Uso de Editoras”].

O objetivo é “estabelecer padrões técnicos compartilhados e estruturas de licenciamento responsáveis que garantam que os desenvolvedores de IA possam acessar jornalismo confiável e de alta qualidade de forma legítima, responsável e conveniente, ao mesmo tempo que asseguram que as editoras mantenham o controle prático de seu conteúdo e recebam um valor justo quando ele for utilizado”.

Leia também na agenteGPT:

💬 Consultoria, treinamento e monitoramento

Acesse monitorGPT no site da agenteINFORMA e saiba as informações para a contratação de palestras, oficinas e treinamentos, além do serviço de gestão e construção de GPTs customizados e de consultoria para adoção do ChatGPT e outras IAs na rotina do seu negócio.

EXPEDIENTE

agenteGPT no WhatsApp

Compartilhe sua experiência com o ChatGPT. Participe do grupo agenteGPT no WhatsApp, aberto para interação.

❤️ Siga no Instagram

Ainda não é assinante da newsletter?

Até a próxima edição.